在数字化转型浪潮中,大数据已成为企业决策的核心资产。海量、多样、高速的数据若缺乏有效治理,非但难以转化为价值,还可能成为负担。大数据治理工程师的角色因此至关重要,他们通过一系列关键技术,确保数据质量、安全与可用性。本文聚焦大数据治理中的数据处理环节,解析其关键技术,助力构建高效、可信的数据环境。

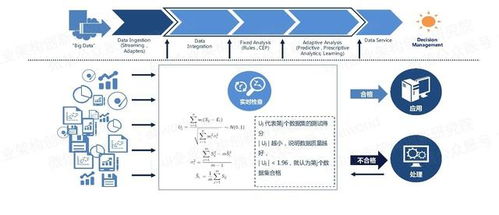

一、数据集成与采集:治理的起点

数据治理始于数据的汇聚。大数据治理工程师需面对异构数据源(如数据库、日志、IoT设备、社交媒体)的挑战。关键技术包括:

- ETL/ELT流程:通过提取(Extract)、转换(Transform)、加载(Load)或其变体ELT(先加载后转换),将分散数据整合到统一平台(如数据湖、数据仓库)。现代工具如Apache NiFi、Airflow支持自动化流水线,提升效率。

- 实时流处理:针对实时数据(如交易日志、传感器数据),采用Apache Kafka、Flink等技术实现低延迟采集与处理,满足即时分析需求。

- API与连接器:标准化接口(如RESTful API)和预建连接器(如CDC变更数据捕获)确保数据源无缝接入,减少手工干预。

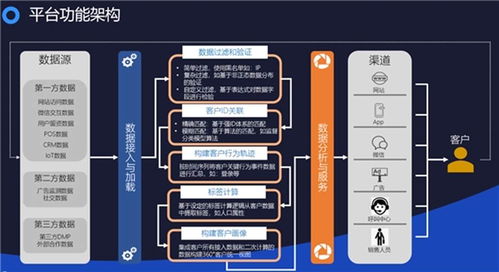

二、数据质量管理:治理的生命线

低质量数据会导致分析偏差与决策失误。大数据治理工程师需构建全链路质量管理体系,关键技术涵盖:

- 数据剖析与评估:自动扫描数据,识别异常值、缺失值、格式不一致等问题,并生成质量报告。工具如Great Expectations、Apache Griffin可设定规则进行校验。

- 数据清洗与标准化:通过去重、补全、格式转换等操作,将数据规范为统一标准。例如,使用正则表达式或自然语言处理(NLP)清理文本数据。

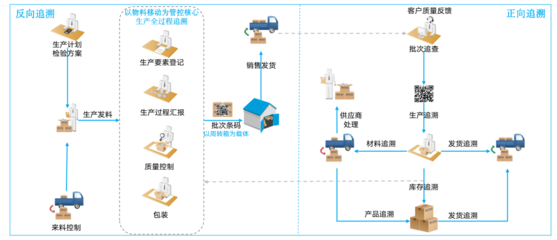

- 数据血缘追踪:记录数据从源到端的流动路径(血缘关系),便于溯源问题根因。元数据管理工具(如Apache Atlas)支持可视化血缘,增强透明度。

三、数据安全与合规:治理的底线

随着法规(如GDPR、数据安全法)趋严,数据安全成为治理的重中之重。关键技术包括:

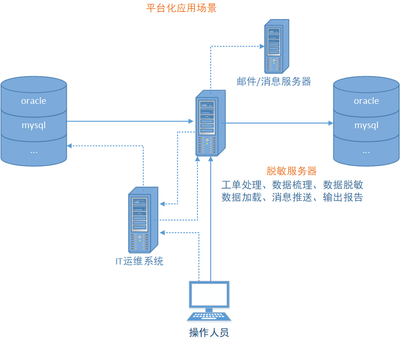

- 数据脱敏与加密:对敏感数据(如个人信息)进行掩码、哈希或加密处理,确保非授权访问下数据不可用。动态脱敏技术可在查询时实时隐藏敏感字段。

- 访问控制与审计:基于角色(RBAC)或属性(ABAC)的权限模型,精细控制数据访问;审计日志记录所有操作行为,满足合规审查。

- 隐私计算:采用联邦学习、安全多方计算等技术,实现“数据可用不可见”,在保护隐私的前提下支持联合分析。

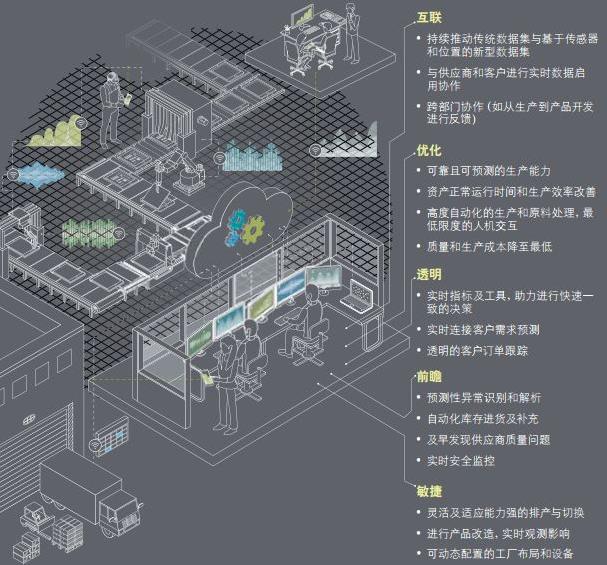

四、数据存储与架构:治理的基石

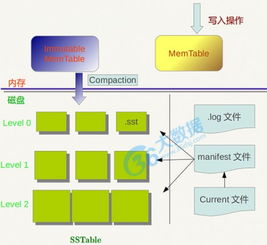

高效的数据处理依赖于合理的存储与架构设计。关键技术涉及:

- 分层存储策略:根据数据热度(热、温、冷)选择存储介质(如SSD、HDD、云存储),平衡成本与性能。数据湖仓一体(Lakehouse)架构(如Databricks)融合数据湖的灵活性与数据仓库的管理能力。

- 元数据管理:统一管理数据的技术元数据(如结构、格式)、业务元数据(如标签、含义),提升数据可发现性与理解度。

- 数据目录:构建企业级数据资产地图,支持关键词检索、数据预览,赋能业务用户自助查找数据。

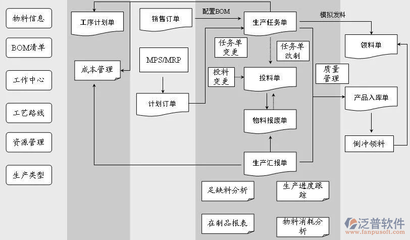

五、数据处理引擎与计算:治理的动力源

数据处理效率直接决定治理效果。关键技术聚焦:

- 批流一体计算:引擎如Apache Spark、Flink支持批量与流式处理统一编程模型,简化开发复杂度。

- 资源管理与优化:通过YARN、Kubernetes等工具调度计算资源,结合查询优化(如索引、分区)提升处理速度。

- 数据虚拟化:在不移动数据的前提下,通过逻辑层集成异构数据源,减少冗余存储与传输开销。

###

大数据治理并非一劳永逸,而是一个持续优化的过程。作为大数据治理工程师,需以数据处理为核心,灵活运用集成、质量、安全、存储与计算等关键技术,构建敏捷、可靠的数据治理框架。唯有如此,企业方能从数据“沼泽”中提炼出真金白银,驱动智能决策与业务创新。

(转自eaworld,聚焦数据处理实践,助力大数据治理落地。)