在当今这个被数字技术深刻重塑的时代,数据已不仅仅是计算机系统中的一串串符号,它已成为驱动社会进步、商业决策和科学发现的核心生产要素。理解数据的基本概念,掌握数据处理与分析的技术脉络,是把握数字时代脉搏的关键。

一、 核心数据概念:从原始记录到战略资产

在数字背景下,我们对“数据”的理解需要超越传统的“数字”范畴,它涵盖了文本、图像、音频、视频、地理位置信息、交易记录、传感器读数等一切可被记录和识别的符号。这些原始记录本身价值有限,但经过定义和组织后,便形成了信息。当信息被置于特定语境中,通过关联、解释和推理,转化为能够指导行动的知识,乃至最终升华为驱动创新的智慧时,数据的价值才得以完全释放。因此,数据本质上是一种需要被“冶炼”和“赋能”的战略资产。

关键概念演进包括:

- 大数据:通常以“4V”特征界定——海量(Volume)、高速(Velocity)、多样(Variety)以及价值密度低但总价值高(Value)。

- 数据资产:将数据视为能够产生经济效益的资源,强调其权属、质量、估值与安全管理。

- 数据要素:这是数据概念在数字经济中的最高形态,指数据作为与土地、劳动力、资本、技术并列的新型生产要素,参与到社会生产的价值创造与分配中。

二、 数据处理:为分析锻造“优质原料”

数据处理是数据分析前的奠基性工作,其目标是将原始、杂乱、不一致的“数据矿石”转化为干净、一致、可用的“数据坯料”。这一过程直接决定了后续分析的可靠性与有效性。

主要环节包括:

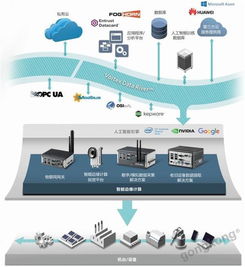

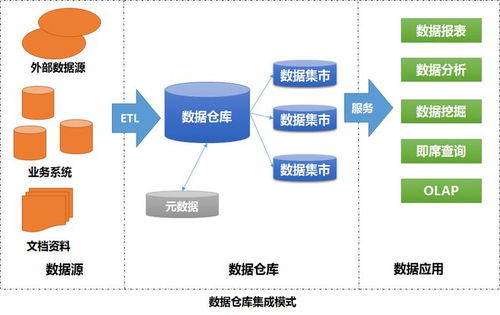

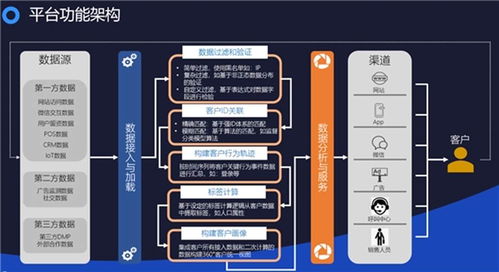

- 数据采集与整合:从数据库、日志文件、API、物联网设备、公开网络等多种异构源系统性地获取数据,并汇集到统一的数据平台(如数据仓库、数据湖)。

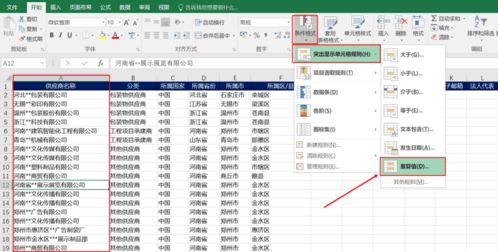

- 数据清洗与预处理:这是数据处理中最繁重也最关键的步骤,涉及处理缺失值、纠正错误值、识别并剔除异常值、消除重复记录、统一数据格式与单位等。

- 数据转换与集成:将数据转换为适合分析的格式,例如进行规范化、聚合、特征工程(创建新特征),并将来自不同源的数据根据关键字段进行关联与融合。

- 数据存储与管理:利用合适的数据库系统(关系型、NoSQL等)或大数据框架(如Hadoop、Spark)进行高效存储、组织与访问,确保数据的完整性、安全性与可追溯性。

三、 数据分析:从洞察到决策的“价值引擎”

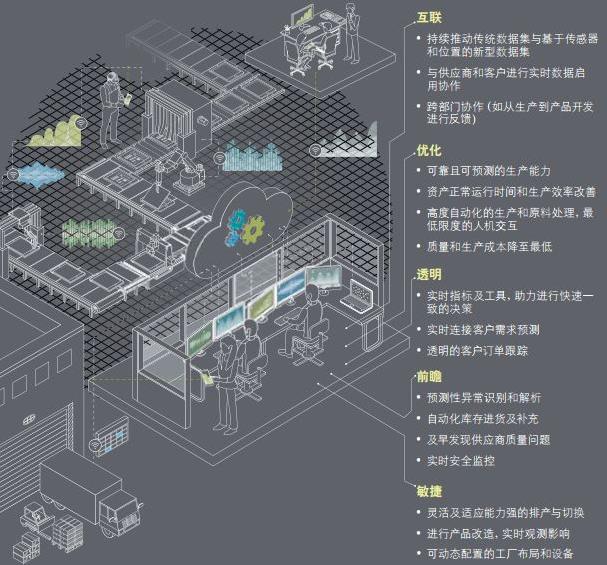

数据分析是运用统计学、机器学习、数据挖掘等方法,对处理后的数据进行探索、建模和解释,以提取有价值的信息、形成结论并支持决策的过程。根据深度与目的,可分为:

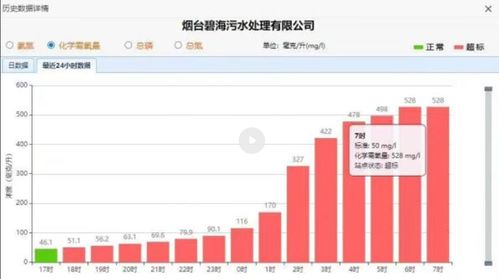

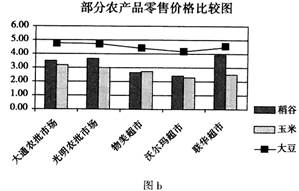

- 描述性分析:回答“发生了什么?”通过汇总、可视化(如图表、仪表盘)描述历史与现状,是大多数商业智能(BI)报告的核心。

- 诊断性分析:回答“为什么会发生?”通过钻取、关联分析和根本原因分析,深入探究现象背后的动因。

- 预测性分析:回答“可能会发生什么?”利用统计模型和机器学习算法(如回归、分类、时间序列分析)基于历史数据预测未来趋势或结果。

- 规范性分析:回答“应该采取什么行动?”这是最高阶的分析,不仅预测还通过模拟和优化算法,在多种约束条件下推荐最优行动方案。

四、 概念的融合:构建数据价值闭环

在实践层面,数据概念、处理与分析并非割裂的环节,而是一个紧密相连、循环迭代的闭环:

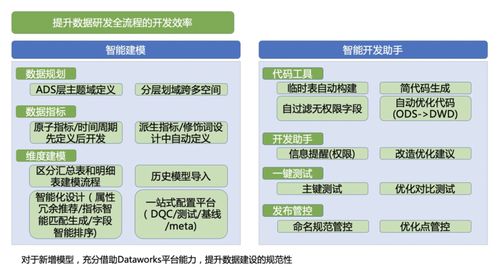

- 以终为始的概念定义:数据分析的目标决定了我们需要哪些数据、如何定义其维度与指标。清晰的数据概念是有效处理的蓝图。

- 处理服务于分析:所有数据处理的技术选择(如清洗规则、聚合粒度)都应围绕后续的分析需求展开,确保产出“分析就绪”的数据。

- 分析驱动概念演进:分析产生的洞察常常会揭示原有数据定义的不足,或催生对新的数据类型的需求,从而推动数据概念的丰富与迭代。

- 从分析回到处理:模型在生产环境中的表现监控,会反馈出数据质量或特征的新问题,进而触发新一轮的数据处理优化。

****

在数字背景下,理解数据从基础概念到要素价值的升华,精通从原始数据处理到深度智能分析的完整链路,已成为个人与组织不可或缺的核心竞争力。这不仅仅是一套技术流程,更是一种用数据理性认知世界、科学决策未来的系统性思维。只有将概念、处理与分析三者有机融合,才能让数据真正“活”起来,源源不断地释放其潜在能量,赋能千行百业的数字化转型与智能化升级。